Информационная война в социальных сетях

Подполковник Джерред Прайер, ВВС США

ревращение социальных сетей в инструмент современной войны не должно вызывать удивления. Интернет-технологии стали отвечать нуждам войны века информации примерно в 2006 г. с зарождением технологии Web 2.0, которая позволяла пользователям Интернета создавать контент вместо того, чтобы просто использовать материал в режиме онлайн. Сегодня люди могут не только выбирать и читать только то, что для них важно, но и использовать средства для создания новостей, основанных на их собственных взглядах. Социальная природа людей в конечном итоге привела к созданию виртуальных сетей. Таким образом, традиционные медийные формы были вынуждены уступить дорогу более адаптивным формам коммуникаций. Противники США быстро нашли пути использования открытости Интернета в своих целях, со временем разработав методы применения социальных медийных сетей в качестве инструментов распространения пропаганды. Социальные сети стали местом для вброса пропаганды и центром информационных операций и кибервойны. Чтобы понять это, мы должны проанализировать важную концепцию тренда социальных сетей и рассмотреть основополагающие элементы пропаганды. Также важны процесс распространения новостей в социальных сетях, особенно распространение «фейковых» новостей, и пути проникновения пропаганды в основные медийные платформы.

Твиттер, Фейсбук и другие сайты социальных сетей с использованием определенного алгоритма анализируют слова, фразы и хештеги и создают список тем, отсортированных в порядке популярности. Этот «список трендов» является быстрым способом просмотреть наиболее обсуждаемые темы на данный момент. Как указывается в докладе «Тренды в социальных сетях: стойкость и исчезновение», подготовленном в 2011 г. Корнельским университетом, трендовая тема «привлекает внимание большой аудитории на короткое время» и тем самым «способствует созданию нужных вопросов для обсуждения». Используя существующие онлайновые сети в сочетании с аккаунтами автоматических ботов (автономных программ, которые могут взаимодействовать с компьютерными системами или пользователями), заинтересованный человек может вставить пропаганду в платформу социальной сети, создать тренд и распространить сообщение быстрее и дешевле, чем при помощи любого другого средства. Социальные сети способствуют распространению нарратива за пределы отдельного социального кластера истинных сторонников путем управления трендом.

Этот процесс строится на четырех факторах:

Этот процесс строится на четырех факторах:

- Сообщение, которое соответствует существующему, пусть и расплывчатому, нарративу

- Группа истинных сторонников, предрасположенных к восприятию этого сообщения

- Относительно небольшая группа заинтересованных людей или «кибербойцов»

- Сеть аккаунтов автоматизированных ботов

Существующий нарратив и поддерживающие его истинные сторонники имеют внутреннее происхождение, так что любая пропаганда, чтобы попасть в их сеть, должна соответствовать этому нарративу. Кибергруппа обычно отвечает за изготовление специального сообщения для распространения. Затем эта группа создает видеоматериалы, мемы или «фейковые» новости, зачастую вступив в тайный сговор с истинными сторонниками. В целях эффективного распространения пропаганды истинные сторонники, кибергруппа и сеть ботов объединяют усилия, чтобы управлять трендом. Таким образом, противник может оказывать влияние на население, используя набор пропагандистских приемов, в основном через социальные сети в сочетании с источниками новостей в режиме онлайн и традиционными СМИ.

Через Твиттер вы можете в режиме реального времени поделиться идеей или событием с кем угодно в мире. Тренд может распространять сообщения широкому кругу пользователей за пределами вашей обычной социальной сети. Более того, недоброжелатели могут использовать тренды для распространения сообщения, используя многочисленные формы СМИ на многочисленных платформах, с одной единственной целью протолкнуть это сообщение в основные медийные источники. Управление трендами является очень эффективным методом распространения информации, посредством которого, как отмечалось в одной статье в газете «The Guardian» в феврале 2017 г., «вы можете взять существующую трендовую тему, такую как «фейковые» новости, и затем превратить ее в оружие. И вы можете обратить это оружие против СМИ, которые разоблачили эти «фейковые» новости». Поскольку Твиттер является платформой, где люди делятся идеями, то он очень популярен среди тех, кому надо быстро распространить информацию, особенно среди журналистов и академических работников. Однако, в последние годы к услугам Твиттер стали прибегать и злоумышленники, стремясь получить те же самые выгоды. В одно время группировки типа Аль-Каиды предпочитали создавать вебсайты, а сейчас «появился Твиттер как онлайновое приложение, которое террористы предпочитают больше всего, даже больше, чем созданные ими вебсайты или Фейсбук», — отмечает Габриэль Вейманн в своей книге «Терроризм и киберпространство: следующее поколение».

Три метода помогают контролировать трендовые темы в социальных сетях: распространение трендов, похищение трендов и создание трендов. Первый метод относительно простой и требует наименьших затрат ресурсов. Распространение тренда – это просто приложение сообщения к каждой трендовой теме. Например, кто-то в Твиттере поместил фотографию президента с сообщением в форме мема – стилистического приема, прилагающего к фото – или видеоматериалу юмористическое сообщение, понятное людям, принадлежащим к определенной культуре, вместе с не имеющим отношения к теме хештегом #SuperBowl. Любой, кто нажмет на этот список трендов, ожидая увидеть что-то, относящееся к футболу, увидит мем, который не имеет никакого отношения к футбольному матчу. Похищение трендов требует больше ресурсов или в виде увеличенного числа последователей, распространяющих сообщение, или в виде сети ботов, предназначенных для автоматического распространения сообщений. Из всех трех методов захвата управления трендами именно создание тренда требует наибольших усилий. Оно требует или финансовых инвестиций в раскручивание тренда, или знания обстановки вокруг темы в социальных сетях и, скорее всего, наличия сети нескольких аккаунтов автоматических ботов. В 2014 г., согласно оценке Твиттера, только 5% его аккаунтов были ботами; сегодня этот показатель возрос до 15%. Некоторые аккаунты представляют собой «новостные боты», которые пересылают трендовые темы. Некоторые аккаунты преследуют рекламные цели и стремятся доминировать в переписке, чтобы получать деньги путем нажатия на ссылки. Некоторые боты являются троллями, которые, как и человеческая версия онлайнового тролля, шлют твит, чтобы прервать обычную безобидную переписку.

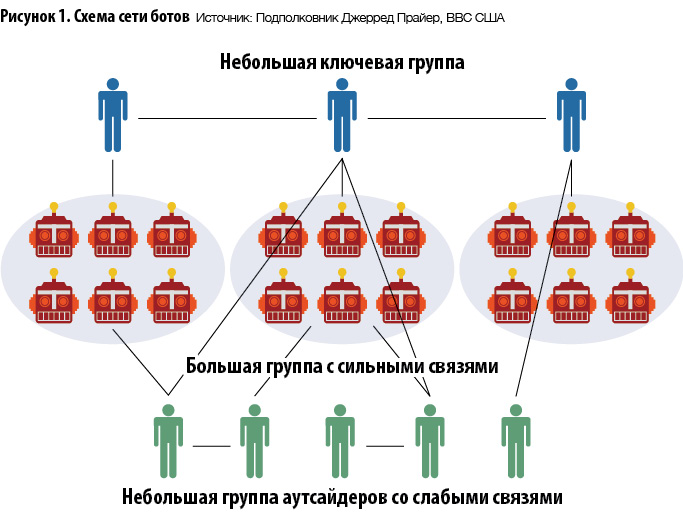

Для злоумышленников, стремящихся оказывать влияние на население при помощи трендов в социальных сетях, наилучшим способом является создание сети аккаунтов ботов, запрограммированных на передачу твитов через различные интервалы времени, на реагирование на конкретные слова или на пересылку твита по указанию мастер-аккаунта. Рисунок 1 в общих чертах дает представление о сети ботов. Вверху цепочки находится небольшая ключевая группа. Эта группа состоит из управляемых человеком аккаунтов с большим количеством последователей. Как правило, аккаунты – это «кибербойцы» противника или истинные сторонники с большим числом последователей. Под ключевой группой расположена сеть ботов. Боты склонны к тому, чтобы следовать друг за другом и за ключевой группой. Внизу под сетью ботов находится группа, состоящая из истинных сторонников, у которых нет большого числа последователей. Эти управляемые человеком аккаунты являются частью сети, но они похожи на аутсайдеров из-за более слабых связей между аккаунтами. У группы в самом низу цепочки нет большого количества последователей, но они следуют за ключевой группой, иногда за аккаунтами ботов и редко друг за другом.

Для злоумышленников, стремящихся оказывать влияние на население при помощи трендов в социальных сетях, наилучшим способом является создание сети аккаунтов ботов, запрограммированных на передачу твитов через различные интервалы времени, на реагирование на конкретные слова или на пересылку твита по указанию мастер-аккаунта. Рисунок 1 в общих чертах дает представление о сети ботов. Вверху цепочки находится небольшая ключевая группа. Эта группа состоит из управляемых человеком аккаунтов с большим количеством последователей. Как правило, аккаунты – это «кибербойцы» противника или истинные сторонники с большим числом последователей. Под ключевой группой расположена сеть ботов. Боты склонны к тому, чтобы следовать друг за другом и за ключевой группой. Внизу под сетью ботов находится группа, состоящая из истинных сторонников, у которых нет большого числа последователей. Эти управляемые человеком аккаунты являются частью сети, но они похожи на аутсайдеров из-за более слабых связей между аккаунтами. У группы в самом низу цепочки нет большого количества последователей, но они следуют за ключевой группой, иногда за аккаунтами ботов и редко друг за другом.

Достаточное количество совместно работающих ботов могут быстро начать тренд или поглотить тренд, но сами аккаунты ботов могут только соединить перемычкой структурный разрыв между сетями, но не могут полностью изменить нарратив. Для изменения нарратива – проведения эффективной операции влияния – требуется, чтобы группа объединила хорошо скоординированную бот-кампанию с важными элементами пропаганды.

БАЗОВЫЕ СВЕДЕНИЯ О ПРОПАГАНДЕ

Чтобы пропаганда работала, ей необходим предварительно существующий нарратив, на котором она будет строиться, а также сеть истинных сторонников, которые уже согласны с изложением основополагающей темы. Социальные сетевые платформы помогают пропагандистам распространять сообщения через созданную сеть. Человек склонен верить информации в социальных сетях, поскольку люди, последователем которых он стал, делятся с ним материалами, соответствующими его существующим убеждениям. Этот человек, в свою очередь, скорее всего, будет делиться информацией с другими в своей сети, с другими единомышленниками и с теми, кто предрасположен к восприятию содержания его сообщений. После многочисленной пересылки информации, конкретная социальная сеть начинает воспринимать пропагандистское сообщение как факт. Однако, до этого момента последствия еще пока носят относительно локальный характер.

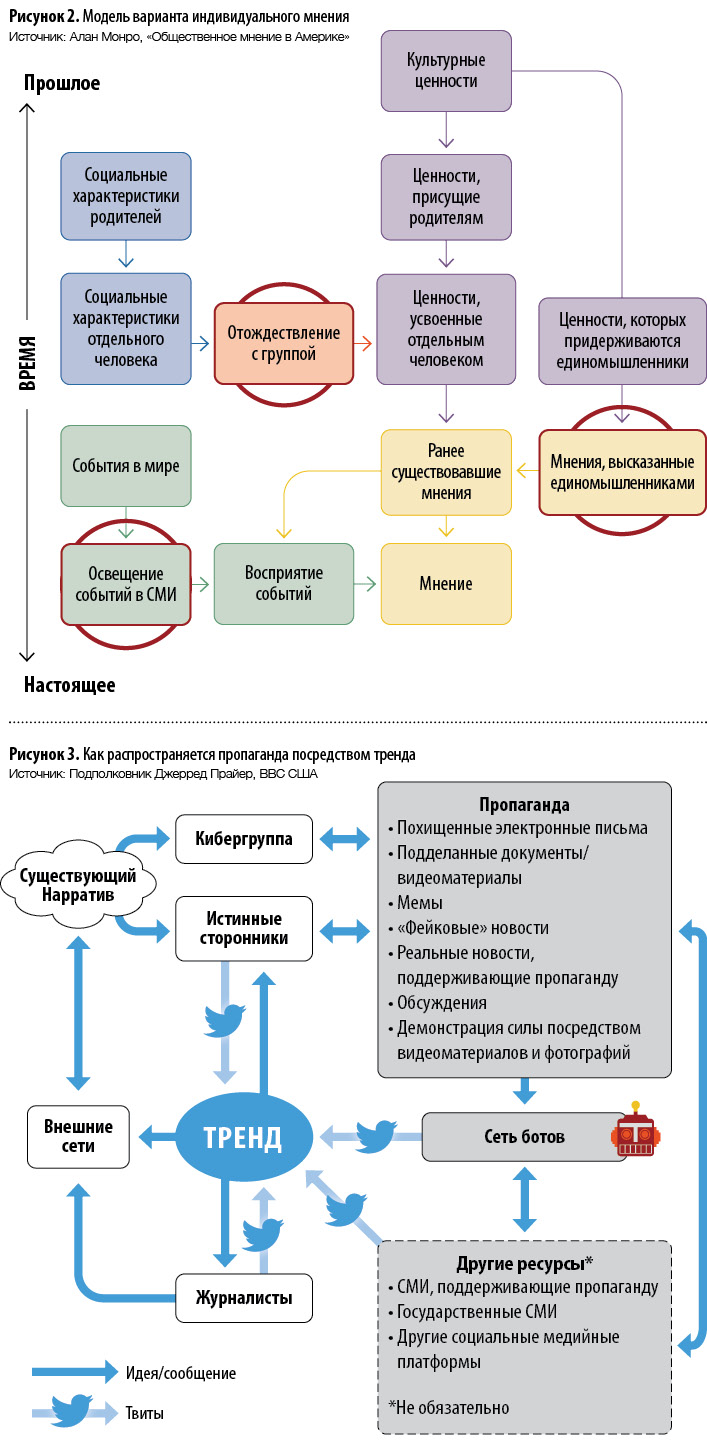

Наиболее эффективные пропагандистские кампании не ограничиваются только теми, кто предрасположен к восприятию содержания пропагандистских сообщений. По большому счету, пропагандой пропитана вся наша повседневная жизнь, и те, кто стал ее жертвами со стороны массированной медийной кампании, так никогда полностью и не поймут, что они не до конца самостоятельно пришли к определенным убеждениям. Уже в наше время пример такого феномена мы наблюдали во время т.н. «Арабской весны», когда распространяемая через Фейсбук пропаганда «помогала среднему классу египтян осознавать, что испытывают разочарование не они одни», пишет Томас Рид в своей работе «Кибервойны не будет». Короче, пропаганда легче усваивается человеком, когда все вокруг него разделяют те же самые эмоции по поводу конкретного предмета обсуждения. Иными словами, пропаганда создает эвристику, являющейся способом упрощения сознанием человека процесса решения проблемы, полагаясь на быстро доступную информацию. В своей работе «Процесс мышления – быстрый и медленный» Даниэль Кахнеман поясняет, что эвристика расценивает количество, частоту и свежесть полученной информации как более значимый фактор, нежели источник информации или ее достоверность. По сути, сознание создает «кратчайший путь» к пониманию, основываясь на всей или наиболее свежей информации, поскольку так эту информацию легче запомнить. Линии на Рисунке 2 изображают процесс формирования краткосрочных мнений, где жирные стрелки влияют на окончательное мнение сильнее, чем тонкие стрелки. Обведенные кругом прямоугольники обозначают обстоятельства, при которых пропаганда проникает в сознание человека. Как объяснялось выше, средства массовой информации способствуют быстрому распространению пропаганды, что, в свою очередь, подпитывает эвристику. При помощи Интернета сознание среднестатистического человека заполняется максимально возможным дневным объемом информации, что способствует пропаганде.

Один из основных принципов пропаганды состоит в том, чтобы сообщение находило отклик у целевой аудитории. Когда люди получают информацию, соответствующую их набору убеждений, предвзятость эту информацию подтверждает, и люди воспринимают пропаганду. Если информация за пределами их сети, люди сначала могут отвергнуть полученное сообщение, но затем большой объем информации может привести к эвристике. Со временем пропаганда становится нормой, и в нее даже начинают верить. Пропаганда подтверждается, когда «фейковое» новостное сообщение появляется в основных медийных источниках, которые стали зависимыми от социальных сетей в части распространения и получения новостей. Рисунок 3 показывает процесс проникновения пропаганды в сеть, которая не предрасположена к благосклонному восприятию данного сообщения. Эта внешняя сеть представляет собой группу, идеологически противоположную группе истинных сторонников. Такая внешняя сеть, скорее всего, знакома с существующим нарративом, но не обязательно согласна с основополагающими убеждениями, поддерживающими нарратив.

Управление трендами сделало возможным создавать «брандспойт информации» для современной модели пропаганды, что в любой момент позволяет введение лживых нарративов. Трендовые материалы создают иллюзию реальности, которую иногда передают в своих репортажах даже журналисты. Поскольку неправда может распространяться очень быстро, Интернет в начале 1990-х гг. посредством распространения слухов, представляемых в качестве достоверных новостей, создал «как умышленную, так и непреднамеренную пропаганду», о чем пишут Гарт Джоветт и Виктория О’Доннелл в своей работе «Пропаганда и убеждение». Превращение со временем такого типа слухов в норму в сочетании со скоростью и объемом новых ложных нарративов в социальных сетях открывает путь «фейковым» новостям.

Эвристика и мощный поток дезинформации могут медленно менять мнение людей по мере того, как пропаганда проходит через сети в форме тренда, но сила влияния, скорее всего, будет минимальной, если только оно не исходит из источника, который покажется заслуживающим доверия человеку, ранее не верившему этим сообщениям. Человек может видеть пропаганду, но все же сомневаться в достоверности информации, пока не прибегнет к заслуживающим доверия источникам, чтобы проверить правдивость этой информации.

СОЦИАЛЬНЫЕ СЕТИ И СОЦИАЛЬНЫЕ МЕДИЙНЫЕ ПЛАТФОРМЫ

СОЦИАЛЬНЫЕ СЕТИ И СОЦИАЛЬНЫЕ МЕДИЙНЫЕ ПЛАТФОРМЫ

По мере расширения использования социальных медийных платформ пользователи стали уютно устраиваться в рамках выбранных ими самими определенных групп, а это означает, что новости и взгляды распространяются почти исключительно среди единомышленников. В сетевой терминологии этот групповой феномен называется гомофилией. В упрощенном виде это соответствует поговорке «Рыбак рыбака видит издалека». Гомофилия в рамках социальных медийных платформ создает ауру компетентности и доверия – факторов, которых бы не было при нормальных условиях. Люди с большей готовностью верят в ту информацию, которая соответствует их мировосприятию. Как считают Джоветт и О’Доннелл, после того, как установлена достоверность источника в какой-то одной области информации, существует тенденция считать этот источник экспертом также и в других областях, даже если эти другие области не имеют ничего общего с первоначальной сферой, в которой источник считался компетентным. В конце концов, как написал Том Хашеми в декабре 2016 г. в материале на вебсайте War on the Rocks, эта «эхокамера» может привести к сценарию, при котором мнение вашего друга «окажется таким же источником тщательного анализа нюансов американской внешней политики в отношении Ирана, как и выкладки специалистов по этому региону, экспертов в области контроля над вооружениями или журналистов, консультирующих Госдепартамент».

Если социальные медийные платформы способствуют развитию самоукрепляющихся сетей единомышленников, то как может пропагандистское сообщение проходить через сети, в которых нет пересекающихся узлов? Эта связь между сетями основывается только на этой единственной теме, и ее легко убрать. Таким образом, чтобы использовать социальные медийные платформы в качестве эффективного инструмента пропаганды, противник должен использовать в своих интересах элемент социальной медийной платформы, который позволяет осуществлять крупномасштабный обмен данными между сетями: список трендовых тем. Тренды видны всем. Независимо от того, кто чьим последователем является на отдельно взятой социальной медийной платформе, все пользователи видят считающиеся наиболее популярными в данный конкретный момент темы, алгоритмически генерируемые самой платформой. Эта глобальная видимость неизбежна, что приводит к тому, что «популярные темы способствуют коллективной информированности относительно того, что сейчас в тренде, а также иногда могут влиять на общественные намерения», говорится в исследовании Корнельского университета. Таким путем трендовая тема может ликвидировать разрыв между кластерами в социальных сетях. Злоумышленник может быстро распространить пропаганду, вставив нарратив в список трендов. Сочетание сетевой структуры социальных медийных платформ, пропаганды и доверия к непроверяемым онлайновым источникам информации дает абсолютно лживым сообщениям возможность влиять на формирование общественного сознания.

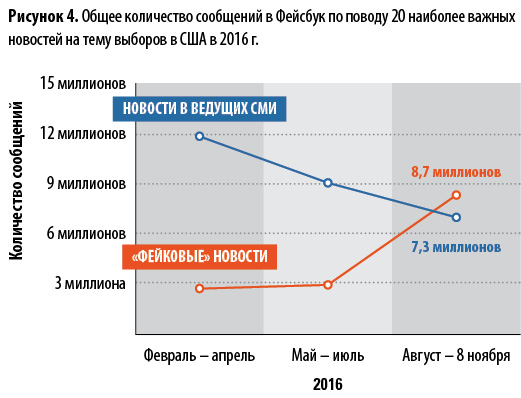

«Фейковая» новость не просто состоит из фальшивого заголовка, невнятного вступительного параграфа и самого сообщения, основанного на недостоверных источниках; это особая форма пропаганды, представляющая лживую историю в виде новостного сообщения. В социальных СМИ это явление становится особенно опасным из-за широкого распространения лживых сообщений, превращенных в сенсации. Впечатляющим примером «фейковых» новостей в социальных СМИ можно считать новостные сообщения, распространяемые в Фейсбук во время президентских выборов в 2016 г. По данным Buzzfeed, сообщение о том, что папа римский поддержал кандидатуру Дональда Трампа, переслали более 1 млн. раз только на Фейсбук, не говоря уже о распространении этого сообщения в Твиттере. Источником сообщения был считающийся патриотическим американский блог Ending the Fed, вебсайт, поддерживаемый румынским бизнесменом Овидиу Дробота. «Фейковые» новости с этого и других сайтов в конце 2016 г. получили больше пересылок, чем традиционные основные новостные источники (см. Рисунок 4).

Важно осознавать, что эти «фейковые» новости увидело гораздо большее количество людей, чем зарегистрированное количество «пересылок». Со временем некоторые люди начинают считать источники «фейковых» новостей достоверными, и по мере того, как они все больше доверяют этим источникам, они меньше доверяют легитимным источникам новостей.

РОССИЯ: МАСТЕРА МАНИПУЛЯЦИЙ

Для России информационная война не является чем-то новым. Еще во времена Советского Союза использовались такие приемы как активные мероприятия и дезинформация. Согласно докладу Госдепартамента о действиях советского руководства в информационной войне, выпущенному в 1987 г., «активные мероприятия отличаются как от шпионажа и контрразведки, так и от традиционной дипломатической и информационной деятельности. Цель активных мероприятий в том, чтобы оказывать влияние на мнения и/или действия отдельных людей, правительств и/или общественности». Иными словами, советские агенты старались вставить пропаганду в существующий нарратив, чтобы очернить страны или отдельных людей. Как однажды пояснил отставной генерал КГБ Олег Калугин, активные меры предназначены для того, чтобы «вбить клин в западные альянсы всех видов, особенно НАТО, посеять разногласия между союзниками, ослабить США в глазах народов Европы, Азии, Африки и Латинской Америки, и таким образом подготовить почву на случай войны». Известный специалист по России Майкл Вайс отмечает: «Наиболее распространенной подкатегорией активных мероприятий является дезинформация: она представляет большую опасность, если изготовленная в московском центре и выглядящая правдоподобной ложь вставляется в надежный медийный источник с целью опорочить демократические государства».

В распоряжении российских троллей есть целый набор государственных ресурсов, включая поддержку со стороны обширной разведывательной сети. В числе имеющихся инструментов также канал RT («Russia Today») и «Спутник» – финансируемые Кремлем телевизионные новостные сети, вещающие на весь мир на многих языках. Прежде чем тролли начнут действовать в социальных СМИ, хакеры из числа «кибербойцов» сначала передают похищенную информацию Wikileaks, которая, по мнению бывшего в то время директором ЦРУ Майка Помпео, является «негосударственной враждебной разведслужбой, поддерживаемой такими государственными субъектами как Россия». Пользуясь терминами разведсообщества, можно сказать, что Wikileaks выполняет роль «ширмы» для российских разведывательных операций – разведывательная информация распространяется через организацию, которая к разведке не имеет никакого отношения. Аналогичным образом в 1980-е гг. в Советском Союзе разведслужбы использовали университеты для публикации материалов пропагандистской направленности. Затем тролли получают управление трендом, распространяя похищенную информацию через Твиттер, для достоверности ссылаясь при этом на Wikileaks и RT. Это невозможно было бы осуществить без существующей в Америке сети истинных сторонников, добровольно распространяющих такие сообщения. Российские тролли и аккаунты ботов также усиливают голоса истинных сторонников. Затем совокупный эффект российских и американских аккаунтов в Твиттере получает управление трендами и распространяет дезинформацию по сетям.

Одна такая новостная «утка» в Твиттере оказалась особенно эффективной во время расовых волнений в студенческом городке Университета штата Миссури. Вечером 11 ноября 2015 г. хештег #PrayforMizzou стал трендом в Твиттере в результате протестов на расовой почве на территории университета, который в разговорной речи студентов назывался Mizzou. Однако, внутри хештега стала развиваться «новость» о том, что по университетскому городку и по прилегающему к нему городу Колумбия маршируют члены расистской организации Ку-клукс-клан, изменяя значение этого хештега, и сделала его самым первым в списке трендов. Пользователь с сетевым именем «Jermaine» (@Fanfan1911) предупреждал жителей о том, что «вместе с ку-клукс-клановцами маршируют полицейские! Они избили моего младшего брата! Берегитесь!». В твит была включена фотография чернокожего ребенка, лицо которого было покрыто синяками; этот твит переслали сотни раз. «Jermaine» и небольшое число других пользователей продолжали слать и пересылать твиты с фотографиями и сообщениями о действиях Ку-клукс-клана и неонацистов в г. Колумбия, критикуя СМИ за то, что они не дают репортажи о том, как расисты устроили беспорядки в студенческом городке.

Анализ последователей «Jermaine» и последователей этих последователей показал, что авторы первоначальных посланий следовали друг за другом и пересылали твиты друг друга, и что их твиты были пересланы автоматически примерно 70 ботами, используя механизм рассылки тренда, который задействовал все трендовые хештеги, бывшие в то время в их твитах, а не только хештег #PrayforMizzou. Распределенные равномерно и пересылаемые реальными людьми, следящими за хештегом Mizzou, твиты через несколько минут стали исчисляться тысячами, и среди них были твиты президента университетского совета студентов, а также местных и общенациональных новостных сетей, которые, поддавшись обману, поддерживали лживый нарратив. Эта провокация прошла гладко и избежала алгоритмов, созданных Твиттером, чтобы отлавливать рассылки при помощи ботов, в основном потому, что хештег Mizzou использовался за пределами этой атаки. Нарратив, установленный как тренд, был похищен, и вместо него была запущена новостная «утка».

Вскоре после кампании дезинформации в Университете штата Миссури, @Fanfan1911 поменял свое сетевое имя с Jermaine на «FanFan», а профильную фотографию чернокожего мальчика поменял на фото немецкого железного креста. В течение следующих нескольких месяцев FanFan слал твиты на немецком языке о сирийских беженцах, а также сообщения, направленные против исламских стран, против Европейского союза и против канцлера Германии Ангелы Меркель. Апогеем стали сообщения о том, как в канун нового 2016 г. беженцы из мусульманских стран насиловали женщин. Некоторые из этих сообщений были лживыми, включая нашумевшее дело о 13-летней девочке из семьи выходцев из России, живущей в Берлине, которая сделала ложное заявление о том, что она была похищена и изнасилована беженцами.

Опять-таки, в этом нарративе доминировала российская пропаганда. Как и в предыдущие кампании по дезинформации в Твиттере, российские тролли смогли распространить дезинформацию, используя в своих целях исходный страх людей и существующий нарратив. Они использовали механизм похищения тренда одновременно с вещанием RT. Пытаясь привлечь больше внимания европейских СМИ к российскому нарративу, направленному против Меркель, российский министр иностранных дел Сергей Лавров обвинил германские власти в «политически корректном покрывании» виновных в деле русской девочки. При содействии натиска со стороны российской пропаганды антииммиграционный нарратив начал распространяться также и традиционными европейскими СМИ.

ВМЕШАТЕЛЬСТВО В ПРЕЗИДЕНТСКИЕ ВЫБОРЫ 2016 г.

Как указано в докладе канцелярии Директора национальной разведки США о российском влиянии на президентские выборы 2016 г., «Кампания по оказанию влияния, организованная Москвой, следовала информационной стратегии, в которой сочетаются тайные разведывательные операции, такие как деятельность в киберпространстве, и открытые усилия российских правительственных учреждений, финансируемых государством СМИ, посредников и проплаченных пользователей социальных медийных платформ или «троллей»». Российская пропаганда легко вплеталась во взгляды сетей «alt-right» и сторонников американского сенатора Берни Сандерса в левом крыле Демократической партии. В сентябре 2016 г. в своей речи кандидат в президенты Хиллари Клинтон назвала половину сторонников кандидата Трампа «жалким сборищем», заявив при этом, что вторая половина его сторонников – это люди, которых система выбросила и которые нуждались в поддержке и сочувствии. Нарратив быстро изменился после того, как сторонники Трампа стали в социальных СМИ давать себе сетевые имена «жалкий» или «сборище».

До появления комментария о «жалком сборище» российские тролли в основном использовали алгоритм для быстрого ответа на твит Трампа, четко выделяя свои твиты сразу под твитами Трампа, как только пользователь нажимал на твит Трампа. После выступления Клинтон пользователю Твиттера нужно было только ввести в строку поиска «жалкие» и тут же получить доступ к сети последователей, насчитывающих от 3 до 70 тыс. человек. И снова имя FanFan было изменено – теперь это было «Жалкая Люси» (Deplorable Lucy) – а на профильной фотографии была изображена белая женщина средних лет с логотипом Трампа в нижней части фотографии. Число последователей FanFan возросло за несколько дней с 1 тыс. до 11 тыс. человек. Его первоначальная сеть, существовавшая во время событий в Университете штата Миссури и информационных кампаний в Европе, также претерпела изменения: следы его сторонников привели к той же группе людей в той же сети, только теперь все они определялись брендом «жалкие» (Deplorable). Короче говоря, теперь они были настроены в унисон с широкой сетью других российских троллей, действительных американских граждан и аккаунтов ботов из двух стран в Твиттере, внезапно облегчив отбор трендов в соответствии с тематикой. Российские тролли могли использовать тактику твитов ботов и похищения хештегов, к которой прибегали ранее, только теперь они обладали возможностью создавать тренды.

Одновременно с реализацией стратегии по сокрытию антитрамповских комментариев в Твиттере, Wikileaks начали публиковать украденную электронную переписку Джона Подесты, руководителя предвыборной кампании Клинтон. Сама по себе переписка не выявила ничего действительно противоречивого, но мощный нарратив, созданный трендовым хештегом, свел воедино переписку Подесты с использованием Клинтон частного почтового сервера в то время, когда она занимала пост госсекретаря. Кроме того, нарратив о переписке Подесты превратил рутинные вопросы в темы для скандалов. Наиболее популярная тема: дискредитировать крупные СМИ, превратив историю с электронной перепиской в теорию заговора, согласно которой СМИ пытались исказить результаты выборов в пользу Клинтон. Нарратив о коррупции также затронул и Национальный комитет Демократической партии, сервер которого ранее в том же году взломали российские хакеры. Об этом говорится в докладе канцелярии Директора национальной разведки США и в сообщениях Wikileaks. В одном из украденных электронных писем Подесты содержалось приглашение на вечеринку дома у друга, в котором говорилось, что будет заказана пицца в пиццерии Comet Ping Pong, а дети смогут поиграть в бассейне. Это было превращено «фейковыми» новостями в теорию заговора (#PizzaGate), предполагавшую, что это письмо было закодированным приглашением на секс-вечеринку педофилов. Это побудило одного мужчину, вооруженного винтовкой AR-15, отправиться в пиццерию Comet Ping Pong освобождать детей из лап подпольного синдиката детского секс-рабства.

Новостная «утка» #PizzaGate вместе с другими ложными и полуправдивыми нарративами стали распространенным явлением в СМИ правого толка, стремящихся показать аморальность Клинтон и ее сотрудников. Довольно часто крупные медийные платформы уделяют неоправданно большое внимание истории с сомнительным происхождением, публикуемой под ложным предлогом, таким образом повышая степень доверия к «фейковым» новостям; однако, «утка» с #PizzaGate последовала за общим пропагандистским нарративом о том, что СМИ пытались скрыть правду, и что правительство так и не провело расследование преступлений. Этот тренд стал настолько сенсационным, что традиционные медийные платформы также решили освещать историю с перепиской Подесты, и это повысило степень доверия к «фейковым» новостям и сопутствующим теориям заговора, проталкиваемым в онлайновом режиме сетью Deplorable Network. Публикация Wikileaks переписки Подесты стало пиком российского управления трендами во время выборов 2016 г. Почти каждый день #PodestaEmail в составе тренда новой порции якобы скандальной похищенной переписки попадал в сообщения основных медийных платформ.

Мой анализ показал, что в сеть ботов входило от 16 тыс. до 34 тыс. аккаунтов. Сплоченность группы показывает, как скоординированные действия могут создать тренд таким образом, каким его не смогла бы создать менее сплоченная сеть. Для проведения кибератак с использованием социальных СМИ в ходе информационной войны, организация должна иметь обширную сеть аккаунтов ботов для получения управления трендом. С неизвестными переменными, такими как последствия «фейковых» новостей, истинные результаты российских операций по оказанию влияния, скорее всего, так никогда и не станут известными. Как сказал философ Жак Эллул, эксперименты по измерению эффективности пропаганды никогда не дадут верного результата, поскольку тесты «не в состоянии воспроизвести реальную ситуацию с пропагандой».

Адриан Чен, репортер газеты «The New York Times», первым обнаруживший сеть троллей в Санкт-Петербурге в 2015 г., летом 2016 г. вернулся в Россию. Российские активисты, у которых он брал интервью, утверждали, что их целью «было не «промывать мозги» читателям, а наводнить социальные медийные платформы лживым контентом, сея сомнения и страх и разрушая возможность использования Интернета как демократического пространства». «Фабрика троллей» использовала похожий прием для того, чтобы заглушить антипутинские тренды в российских социальных СМИ. В докладе Исследовательской службы Конгресса США, опубликованном в январе 2017 г., кратко изложены цели и результаты операции российских троллей: «Киберинструменты также использовались [Россией] для создания психологического эффекта в американском обществе. В числе возможных побочных эффектов этой деятельности – подрыв доверия к публикуемой информации, внесение разногласий и сомнений в американское общество относительно достоверности отчетов американских разведслужб и возникновение вопросов относительно самого демократического процесса».

Для России информационная война – это специализированный вид войны, и современные инструменты превращают социальные СМИ в оружие. Как считает один бывший высокопоставленный сотрудник администрации Обамы, русские рассматривают информационную сферу как среду ведения войны в пределах конфликта переменной интенсивности, который постоянно существует между США и Россией. Такая постановка вопроса рассматривалась на конференции по вопросам национальной безопасности России «Инфофорум–2016», на которой один из ведущих советников Кремля Андрей Крутских сравнил российскую информационную войну с ядерной бомбой, которая «позволит России разговаривать с американцами на равных», имея ввиду такой же эффект, который имело испытание советской атомной бомбы в 1949 г.

БУДУЩЕЕ СОЦИАЛЬНЫХ СМИ, ПРЕВРАЩЕННЫХ В ОРУЖИЕ

Кампании по очернению противника существуют столько же, сколько существует политика, однако, новаторские методы, которые стали применяться не так давно, стали заслуживать доверия после трендовых нападений в Твиттере. Нападения, часто замаскированные под кампании «правдоискателей», придают простым политическим действиям скандальный характер. Так же, как и было в случае с публикацией электронной переписки Подесты, несколько политиков и крупных бизнесменов в разных странах мира стали жертвами такого вида нападений.

Вспомните нападение северокорейских хакеров на Sony Studios в 2015 г. Негативные последствия для компании имела не столько сама хакерская атака, сколько публикация щекотливых электронных писем старших руководителей Sony, а также информация о зарплате каждого сотрудника. Возмущение по поводу этих писем захлестнуло социальные медийные платформы, причем часто оно подогревалось пикантными историями, как, например, репортажем RT под заголовком «Утечка переписки Sony показывает, на что идут богатые сотрудники компании, чтобы устроить своего ребенка в привилегированный американский университет». В результате, Sony уволила высокопоставленную сотрудницу компании из-за содержания ее переписки. Еще один пример – в мае 2017 г. девять гигабайтов электронной переписки, похищенной у сотрудников Эммануэля Макрона во время его борьбы за пост президента Франции, были выставлены в интернете и подтверждены Wikileaks. Как следствие этого хештег #MacronLeaks стал трендом номер один по всему миру. Эта операция по оказанию влияния напоминает кампанию #PodestaEmail, причем в обоих случаях некоторые исполнители были одни и те же. За несколько недель до выборов во Франции многие аккаунты в Deplorable Network поменяли свои названия для того, чтобы поддержать оппонента Макрона Марин Ле Пен. Эти аккаунты слали твиты в основном на английском языке и все еще были вовлечены в американские политические темы наряду с французскими. Некоторые аккаунты также слали твиты на французском языке, и некоторые франкоязычные аккаунты ботов использовали те же самые методы, что и Deplorable Network, чтобы заполучить управление трендом.

В своей книге «Спустившись с гор» Давид Килкуллен описывает будущее, состоящее из крупных прибрежных городских районов, полных связанных между собой потенциальных опасностей. Это может привести к двояким последствиям. Во-первых, сети негосударственных злоумышленников могут объединиться, чтобы похищать социальные СМИ. Хотя у этих групп, возможно, и не будет достаточно потенциала, чтобы создать глобальные тренды, они точно смогут внести хаос с меньшим количеством, похищая тренды и создавая местные тренды. Обладая минимальными ресурсами, небольшая группа может создать сеть ботов для распространения своего сообщения. Во-вторых, большое количество людей с доступом к социальным медийным платформам подвержено влиянию пропаганды, распространяемой в режиме онлайн. В этом случае государственные субъекты могут начать действовать по российскому учебнику. Скорее всего, Россия будет продолжать доминировать на этом новом поле боя. У нее есть разведывательный потенциал, хакеры, тролли из числа «кибербойцов», обширные сети ботов, государственные новостные сети с глобальной аудиторией и уже сложившиеся сети в тех странах, против которых Россия планирует совершить нападение через социальные СМИ. Что крайне важно, у русских уже есть опыт в распространении пропаганды. После американских выборов 2016 г. российские тролли стали пытаться оказать влияние на выборы в европейских странах. Они активно действовали во Франции, на Балканах и в Чехии, используя активные мероприятия и принудительные сообщения в социальных СМИ, о чем пишет Энтони Файола в статье в газете «The Washington Post», опубликованной в январе 2017 г.

ЗАКЛЮЧЕНИЕ

Пропаганда является мощным инструментом, и при ее эффективном использовании можно манипулировать большими массами населения. Использование социальных медийных платформ для получения управления трендами делает распространение пропаганды государственными и негосударственными субъектами легким, как никогда ранее.

К счастью, компании социальных сетей предпринимают шаги по борьбе с злоумышленниками. Фейсбук повышает уровень информированности пользователей относительно «фейковых» новостей и разработал процедуры удаления ссылок со своего вебсайта. Твиттер начал осмотрительно удалять сомнительные тренды в течение нескольких минут после того, как у них начинал наблюдаться рост популярности. Однако, противник адаптируется, и тролли в Твиттере пытаются восстановить свой контроль над трендом, умышленно делая ошибки в названии предыдущего тренда, изъятого из обращения.

Меры, предпринятые Фейсбук и Твиттером, важны для предотвращения войн в информационной среде. Тем не менее, у Твиттера будут сохраняться проблемы с похищением трендов и сетями ботов. Как было показано в случае с #PrayforMizzou, реальные события, происходящие по всему миру, будут сохранять популярность, поскольку простые доброжелательные пользователи хотят иметь возможность обсуждать различные вопросы. Убрав функцию трендов, можно прекратить использование социальных сетей в качестве оружия, но при этом снизится ценность пользования Твиттером. Удаление аккаунтов ботов имело бы такой же эффект, поскольку это почти уничтожило бы возможность создания трендов. К сожалению, это нанесло бы серьезный удар по рекламным агентствам, которые в поступлении доходов от своей продукции зависят от Твиттера.

В то время как компании социальных сетей пытаются сбалансировать интересы их бизнеса и стремление действовать во благо общества, другие институты должны реагировать на использование социальных сетей злоумышленниками. В частности, доверие к нашей прессе было поставлено под вопрос из-за кампаний по оказанию влияния в социальных сетях. Например, новостные платформы в отношении своих служащих должны принять политику, объявляющую нежелательным использование Твиттера в качестве источника новостей. Это потребует определенных культурных подвижек в мире прессы. К счастью, эта идея привлекла значительное внимание в университетах, исследующих роль СМИ в операциях по оказанию влияния. Следует отметить, что французская пресса не освещала содержание похищенной переписки в ходе предвыборной кампании Макрона; вместо этого журналисты обсуждали вопросы хакерства и операции по оказанию влияния и выражали сомнения в достоверности похищенных и опубликованных материалов.

И наконец, избранные госчиновники должны прекратить свои партийные споры относительно российского влияния на выборы с США в 2016 г. Для этого требуется две вещи: во-первых, обе политические партии должны признать, что же произошло – не преуменьшая, но и не преувеличивая российские активные мероприятия. Во-вторых, и это наиболее важно, политики должны принять обязательства не использовать активные мероприятия России себе на пользу. Конечно же, привлекательность бесплатной негативной рекламы заставит любого политика подумать дважды об использовании дезинформации против оппонента, но дело в том, что иностранные операции по оказанию влияния наносят ущерб не только соперничающей партии, они наносят ущерб нашим демократическим идеалам. Ныне покойный американский сенатор Джон Маккейн кратко и верно сформулировал эту опасность в интервью с корреспондентом Си-Эн-Эн: «Несомненно, то, что русские попытались сделать с нашими выборами, могло бы разрушить демократию. Поэтому нам надо… более пристально следить за действиями русских».

Нам обещали другой вид кибервойны. Прогнозы относительно катастрофической кибератаки доминировали в политических дискуссиях, но немногим приходило в голову, что социальные сети могут быть использованы в качестве оружия, направленного против сознания населения. Россия являет собой пример воюющей стороны в этой будущей войне, в которой социальные СМИ используются непосредственно для оказания влияния на людей. По мере того, как совершенствуются технологии, оттачиваются методы и Интернет становится доступным во всех уголках мира, все больший смысл приобретает следующее высказывание: «Тот, кто управляет трендом, будет управлять и нарративом – а именно нарратив, в конечном итоге, управляет волей людей».

Комментарии закрыты.